Introduction

농업인구는 지속적으로 감소 및 고령화되고 있어 국내 농업의 경쟁력 확보와 미래 식량안보 해결을 위해서는 무인·자동화 기술 개발을 통한 생산성 향상이 필요하다. 무인·자동화 기술은 경운, 수확, 방제 등의 농작업에 따라 다양한 기술들이 개발되고 있으며, 이 중 자율주행 기술의 경우 농업용 로봇의 핵심요소로서, 일정한 면적을 왕복하며 규칙적인 작업의 특성을 가지는 농업기계의 자동화에 효과적이다(Choi and Hong, 2019). 특히, 과수원의 경우 동일한 종류의 과수가 직선상에 규칙적인 간격으로 재식되어 있으며, 사용되는 작업기는 과수열 사이의 직선 경로를 반복적으로 이동하여 수행하기 때문에 자율주행 기술 적용 및 실용화가 용이하다. 농업 자율주행 연구는 최근 트랙터 등 주요 농업기계 중심으로 진행되고 있으며, 경운작업의 경로 검출 기술(Kayacan et al, 2015; Kim et al, 2013)가 대표적이다. 특히, 과수원 관련 연구에서는 기계시각(machine vision) 기반의 과수열 인식 및 주행로 인식(Bayram et al, 2019)이 최근 진행되고 있다.

감귤의 경우 가공제품의 원료로 널리 활용되는 국내의 대표적인 과수원 재배작물로 17년 총수입은 약 1조원에 달하지만 타 과수에 비해 집약식 농법의 밀식재배로 방제 작업의 기계화율이 낮다(Kang and Lee, 2019). 이를 해결하기 위해 최근 감귤과수원에 적용 가능한 소형 무인 스피드 스프레이어(speed sprayer, SS)가 개발되었으며, 작업 효율 등이 향상되었다고 보고되었다. 하지만 개발된 방제기의 경우 작업자가 리모트 컨트롤을 이용하여 따라다니면서 조작하므로 불편함을 유발할 뿐만 아니라 쉽게 농약에 노출될 수 있어 무인화가 필요한 실정이다(Han and Park, 2019).

따라서, 본 연구에서는 감귤과수원 내 무인 방제기 개발을 위해 수행되었으며, 영상 기반 감귤 과수원 경로인식 기술을 개발하였다. 과수원 내 방제기 주행 시 정면 영상을 수집한 후 휴리스틱 기반의 영상처리로 경로영역 분리 및 주행방향을 검출하였으며, 다양한 영상을 이용하여 성능을 평가하였다.

Material and Method

감귤과수원 영상

감귤 과수원은 과수가 일직선으로 늘어서 있는 반구조화된 환경으로 일정한 간격으로 재식되어 있다. 과수원 내 제초, 방제 등 작업은 과수열 사이를 이동하며 수행되며, 작업 중 장면의 좌우에는 과수 영역이 존재하며, 양쪽의 과수 영역과 중간의 토양 영역의 경계면이 주행경로의 경계를 나타낸다. 이때, 원근으로 인해 좌우 경계는 RGB 영상의 수평방향 중심으로 향하게 되며, 경계가 만나는 소실점(vanishing point)이 경로의 방향이다(Jiang et al, 2016).

과수원 작업경로 검출

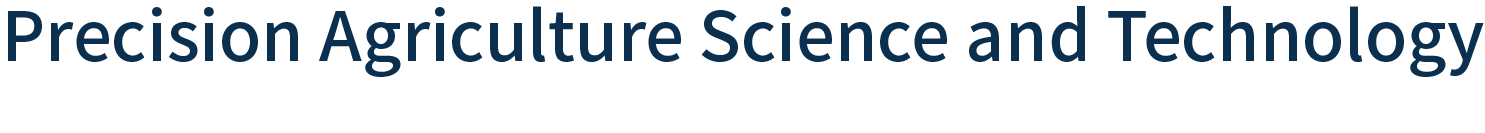

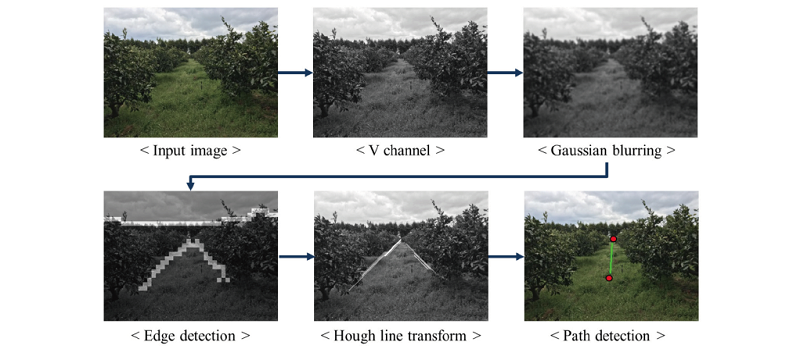

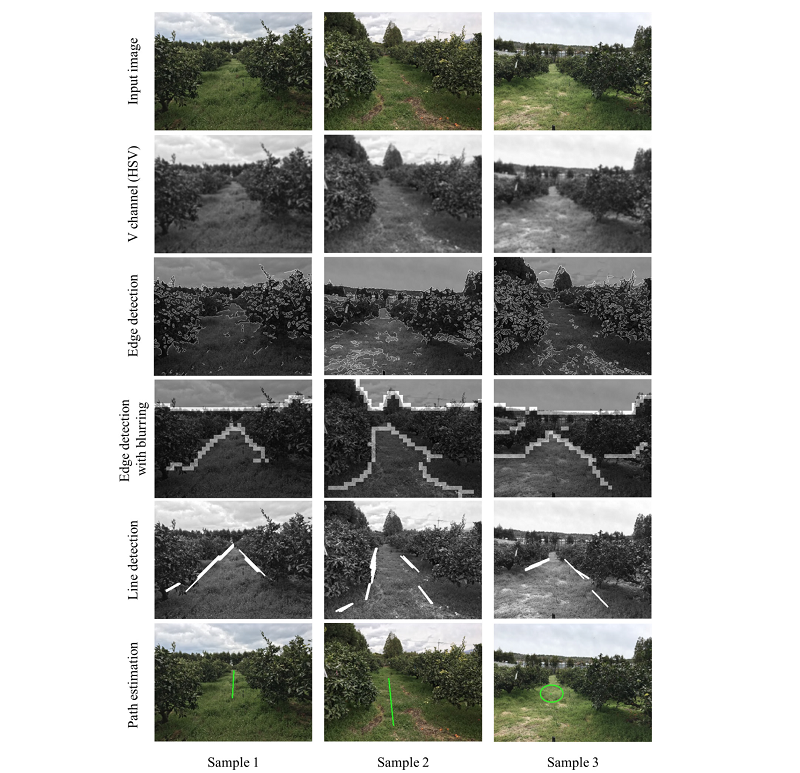

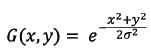

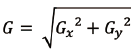

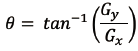

과수원 작업경로 검출은 Fig. 1과 같이 색상모델 변환, 잡음 제거, 에지 검출, 직선 검출 및 경로 검출의 단계로 구성되었다. 수집된 RGB 영상은 상대적으로 조도변화에 강인한 HSV 색상모델로 변환 후 명도(value) 채널을 추출하였으며, 이를 식 (1)과 같은 가우시안 블러링(gaussian blurring)을 통해 잡음을 제거하였다. 이때 과수 잎 간 혹은 토양표면의 거칠기로 인해 발생되는 잡음이 제거되며, 주요 영역 간의 경계만 남게 된다. 잡음이 제거된 영상 내 과수영역과 작업경로를 분리하기 위해 캐니 에지 검출(canny edge detection)을 이용하여 주요 에지를 검출한 후 허프 변환(hough transform)을 이용하여 경계 직선을 생성하였다. 캐니 에지 검출은 다른 경계 검출 알고리즘 보다 오차율이 낮고 복잡한 영상에서도 효과적으로 경계 에지 검출이 가능하다는 장점을 가지고 있으며, Fig. 2와 같이 noise reduction, edge gradient detection, NMS (non-maximum suppression), hysteresis thresholding의 4단계로 구성되어, 잡음 최소화, gradient 크기 및 방향의 에지 후보 검출, 주요 에지 검출, 에지 강도의 상한 및 하한 경계를 통한 에지 판별을 수행한다. 이때 gradient의 크기 및 방향은 각각 식(2), (3)와 같이 계산된다. 허프 변환은 영상에서 (x, y)좌표 공간의 픽셀들은 (r, θ) 매개변수 공간에서 곡선의 형태이며, 식(4)와 같이 나타난다. 또한, (x, y) 좌표공간에서 같은 직선상에 존재하는 픽셀들의 경우 (r, θ) 매개변수 공간에서 교점을 가지게 된다. 허프 변환은 영상의 특징 픽셀들을 원점으로부터의 거리 및 회전각도를 매개변수로 가지는 공간으로 맵핑(mapping)시킨 후, 보팅(voting) 과정을 통해 대표적인 직선을 추출하는 방법이다. 따라서, 생성된 양쪽 경계의 에지들을 대표할 수 있는 직선을 허프 변환을 이용하여 생성하였으며, 이때 모든 점에 대해서 계산을 하기 때문에 시간이 많이 소요되기에 임의의 점을 이용하여 직선을 찾는 확률 허프 변환(probabilistic hough transform)을 이용하였다. 주행경로는 검출된 좌, 우 경계직선이 교차하는 소실점 및 영상 하단의 중심점을 이용하여 결정되었다.

(1)

(1)

(2)

(2)

(3)

(3)

Where, σ = standard deviation in gaussian distribution

Gx = gradient at x-axis value

Gy = gradient at y-axis value

G = gradient magnitude

θ = gradient angle (deg)

실험방법

과수원 영상 내 작업경로 검출 기술 개발을 위해 제주도 서귀포 소재의 국립원예특작과학원 감귤연구소 테스트베드(33.302615°N, 126.611956°E)에서 2019년 5월 ~ 7월 기간동안 영상을 수집하였다. 이때 과수원 내 과수의 재식거리는 약 3m이며, 과수 열 사이 경로의 폭은 약 2.9m이다. 영상은 스마트폰(Galaxy Note 9, Samsung, Korea)을 이용하여 총 20장을 수집하였으며, 이때, 카메라는 12.0 MP 화소로 오토 포커스 모드를 이용하였다. 경로검출의 성능평가는 수집된 영상 및 웹 검색을 통해 수집된 영상을 활용하였으며, 웹 다운로드 영상은 현재 과수원와 유사한 영상을 육안으로 판별하여 총 20장 수집하였다.

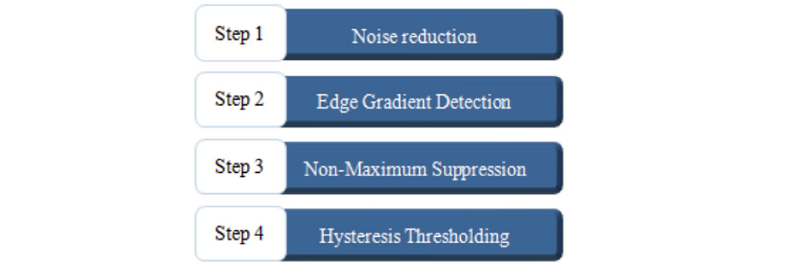

경로 검출의 성능은 에지 검출(edge detection), 경계선 검출(line detection), 경로 생성(path generation)의 3가지 항목에 대해 평가하였으며, 각각 전체 영상에 대해 검출된 영상의 비율로 나타내었다. 이때, 각각의 항목에 대한 검출 여부는 육안을 시용하여 수동으로 평가하였다.

영상처리 및 결과의 시각화에 사용된 소프트웨어는 파이썬(version 3.7, Python, Software Foundation, USA)이며, 라이브러리는 Opencv (version 3.3, Intel co, USA)이다.

Results and Discussion

Fig. 3은 감귤과수원에서 촬영한 영상 내 경로 검출 결과의 대표적인 영상들이다. 영상 내 각각의 열은 영상 샘플이며, 각각의 행은 원 영상, 명도 채널, 에지 검출, 경계 검출, 경로 생성을 나타낸다. 에지 검출의 결과는 가우시안 블러링 전, 후의 결과를 각각 제시하였으며, 이를 통해 블러링에 따른 성능의 차이를 알 수 있었다. 이때 블러링 전, 후의 에지 검출의 상한과 하안은 실험적으로 선정하였으며, 블러링 전의 경우 높은 화질로 인한 과수의 구성요소인 잎, 가지 등의 경계 검출로 인해 영역 사이의 주요 경계 검출이 어려웠다. 영역 사이에서 검출된 에지를 확률적 허프변환을 이용하여 경계 직선을 검출하였으며, 검출된 좌, 우 직선들을 이용하여 작업 경로를 생성하였다. 작업 경로가 직선의 형태로 원활하게 검출된 샘플 1, 2의 경우와는 달리, 샘플 3의 경우 점의 형태로 표현되었는데, 경계를 통해 생선된 직선이 하나의 행에 존재하거나 점의 형태로 관찰된 결과로 판단된다.

온라인 검색을 통해 수집된 영상들을 이용하여 과수원 작업경로를 검출하였으며, 이때 영상들은 본 연구에서 사용된 과수원과 유사한 형태의 사진을 육안으로 판별하여 사용하였다. Fig. 4은 온라인에서 과수원 영상을 수집하여 작업경로를 검출한 대표적인 결과이며, 첫번째, 두번째 행은 각각 경로 검출이 가능한 영상 샘플들, 두번째 행은 경로 검출이 불가능한 영상 샘플들을 나타낸다. 좌우의 과수영역과 작업경로의 경계가 육안으로 명확한 경우 작업경로 검출이 원활하게 가능하였지만, 상대적으로 경계가 모호하거나, 직선의 형태가 아닌 복잡한 형태를 지니는 경우 본 연구의 알고리즘으로 검출이 어려움을 알 수 있다. 제주 감귤과수원 및 온라인에서 수집된 영상을 이용한 성능평가 결과는 Table. 1과 같으며, 에지, 경계직선 및 경로생성이 각각 85, 75, 70%의 검출율을 보였다.

Conclusion

본 연구에서는 과수원 영상을 이용하여 영상기반 경로인식 및 직진경로 예측을 목적으로 실시되었다. 과수원 내 작업경로 영역은 작업기의 주행방향 정면의 영상을 이용하여 색상모델 변환, 블러링, 에지 검출을 통해 경로영역을 인식하고, 이를 통해 주요 직선경계를 검출하며 과수영역 및 주행로를 검출하였다. 주요 결과로는 경로인식 결과, 대부분의 제주 감귤과수원 영상에서는 높은 검출율을 보였지만, 온라인으로 수집된 영상의 경우, 영역간의 차이가 명확하지 않거나 경계가 복작한 형태를 보이는 경우 검출에 어려움이 있었다. 따라서, 다양한 영상에 대한 강인한 성능을 보이기 위해서는 잡음제거 및 에지 검출 알고리즘의 성능 개선이 필요하며, 이를 통해 실시간 영상을 이용한 경계 검출이 가능할 것으로 판단된다.